¿Qué es un Headless LMS y por qué se ha convertido en la arquitectura preferida por instituciones educativas que buscan innovar sin comprometer la estabilidad de su plataforma? En este artículo descubrirás cómo separar la gestión académica de las capas de innovación mediante estándares como LTI 1.3 y APIs, permitiéndote escalar tu ecosistema EdTech sin romper el sistema que ya funciona.

Por un lado, la institución crece. Aparecen más alumnos, nuevos programas y mayor presión para ofrecer una experiencia digital de alta calidad.

Al principio, el LMS cumple su papel a la perfección. Plataformas como Moodle, Canvas o Blackboard permiten ordenar cursos, gestionar usuarios y centralizar la operación académica sin problemas.

Sin embargo, con el tiempo, empiezan a aparecer señales difíciles de ignorar.

Por ejemplo, el equipo técnico tarda meses en lanzar una función nueva. A su vez, los profesores sienten que cada mejora implica aprender un flujo más complejo. Por otro lado, los alumnos comparan la experiencia del LMS con las apps que usan a diario y notan una gran diferencia. Además, la analítica existe, pero no responde a preguntas estratégicas. En consecuencia, cada actualización genera miedo por el impacto en los plugins personalizados.

Este es justo el punto donde el sistema deja de ser solo una herramienta y se convierte en un cuello de botella para la innovación.

🔴 Síntoma

Todo tarda demasiado

Cada mejora depende del núcleo del LMS, de plugins y de compatibilidades cruzadas.

🟠 Riesgo

Innovar rompe la estabilidad

La plataforma académica empieza a mezclarse con experimentos de producto, IA y nuevas interfaces.

🟢 Solución

Separar responsabilidades

El LMS conserva la verdad académica. Mientras tanto, la innovación se construye fuera y se conecta con estándares.

La clave no es cambiar de LMS. La clave es dejar de usar el LMS como si fuera el único lugar posible para innovar.

El problema no es que el LMS sea malo. De hecho, normalmente ocurre lo contrario: sigue siendo una pieza muy valiosa para la gestión. No obstante, el problema aparece cuando intentamos que resuelva necesidades para las que no fue diseñado.

Una plataforma pensada para gestionar cursos y notas no siempre es el mejor lugar para construir experiencias interactivas o IA generativa. Por ello, surge la pregunta clave:

¿Cómo podemos innovar sin romper el LMS que ya sostiene la operación?

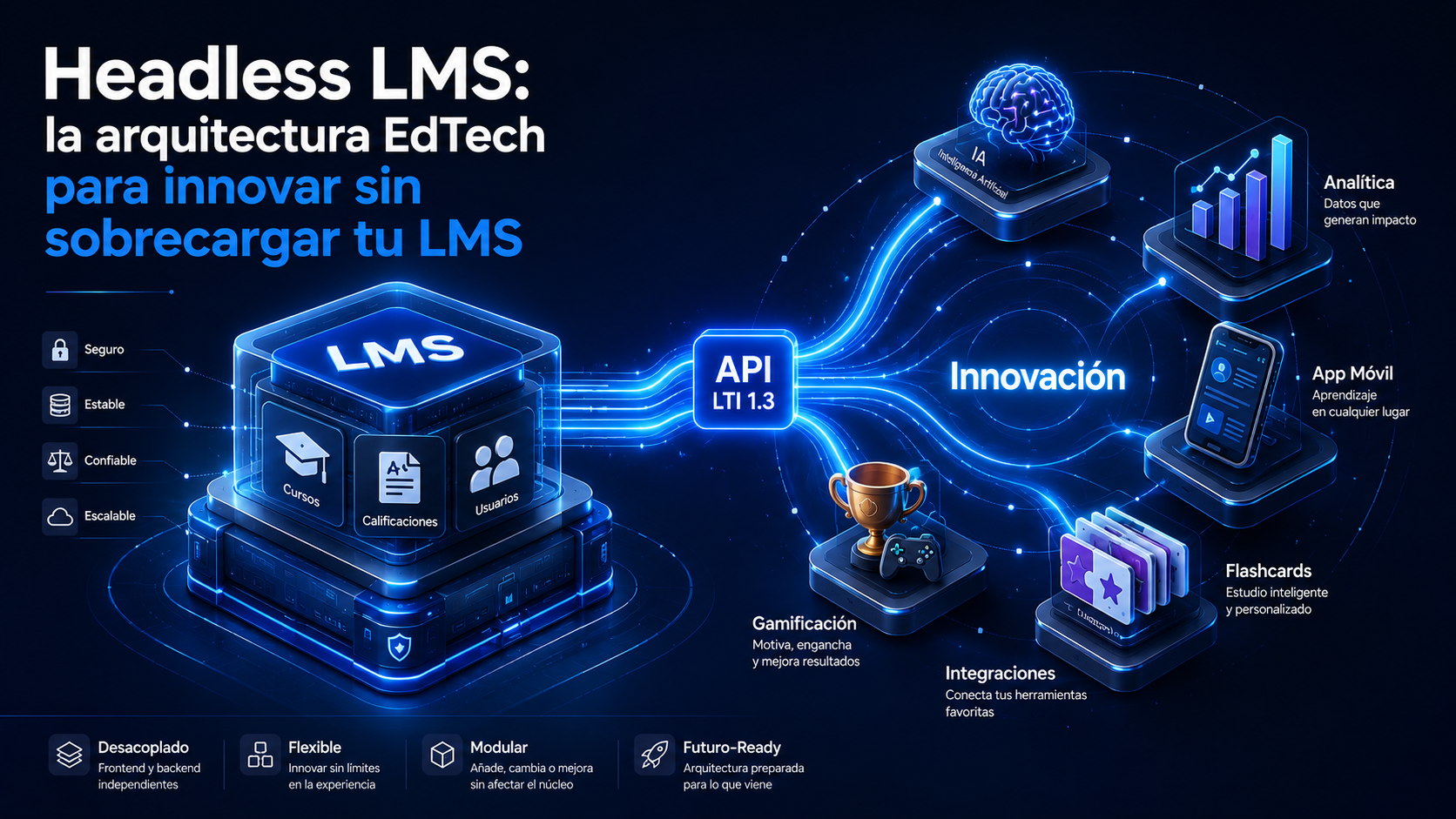

La respuesta está en diseñar una arquitectura Headless LMS.

En este artículo veremos cómo esta arquitectura permite escalar y mejorar la experiencia sin abandonar el sistema que ya funciona. Esta es la continuación natural de una idea que ya abordé en el artículo sobre la trampa del LMS.

Headless LMS: qué es y por qué empieza a ser necesario

Definición rápida: qué es un Headless LMS

Básicamente, un Headless LMS es una arquitectura donde el LMS —como Moodle o Canvas— mantiene la gestión oficial. Mientras tanto, la experiencia de usuario, la IA y la analítica se construyen fuera y se conectan mediante estándares como LTI 1.3 de IMS Global y APIs.

Hay una señal que suele pasar desapercibida al principio: la organización deja de preguntar «qué permite hacer el LMS» y empieza a preguntar «qué nos impide hacer».

Ese cambio de pregunta es muy importante.

Mientras el LMS resuelve la operación diaria, nadie cuestiona su papel. Sin embargo, cuando la institución quiere diferenciarse por experiencia o datos, el sistema empieza a mostrar sus límites naturales.

Esto no significa que haya fallado, sino que ha cambiado el tipo de problema. En efecto, gestionar cursos no es lo mismo que diseñar una experiencia digital moderna.

Por consiguiente, muchas instituciones intentan resolver problemas de producto digital con herramientas pensadas para administración académica.

Por qué el LMS tradicional empieza a limitar la innovación

Durante años, el LMS fue la pieza central. Y tenía todo el sentido.

Al principio, la prioridad era resolver problemas básicos: publicar contenidos, gestionar matrículas y crear cuestionarios. Para muchas organizaciones, esto supuso un salto enorme.

No obstante, el contexto ha cambiado.

Hoy en día, una organización educativa compite por experiencia, personalización y datos. Los alumnos esperan interfaces fluidas, similares a las apps que usan a diario. Además, los responsables de negocio necesitan saber qué programas funcionan y dónde se pierde el interés.

Por esta razón, las limitaciones del LMS empiezan a hacerse visibles. No porque el sistema sea inútil, sino porque le estamos pidiendo un papel que ya no le corresponde.

El coste oculto de meterlo todo dentro del LMS

Una de las razones por las que muchas organizaciones tardan en adoptar una arquitectura Headless es que el coste de no hacerlo no siempre es visible en el presupuesto.

Claro que no suele haber una línea llamada «coste de complejidad». Pero existe.

Por ejemplo, esto ocurre cuando una actualización menor requiere semanas de validación. También sucede si un plugin crítico deja de mantenerse. Incluso se nota cuando el equipo técnico evita tocar ciertas partes por miedo a romper procesos. En definitiva, es el coste de oportunidad perdido.

Cada mes que una institución tarda en lanzar una experiencia móvil o un asistente IA, es un mes en el que sus alumnos usan una experiencia menos competitiva.

Diagnóstico técnico

Checklist técnico: señales de que tu LMS es un cuello de botella

Si reconoces más de dos de estos síntomas, probablemente el problema no sea solo funcional, sino arquitectónico: el LMS está asumiendo demasiadas responsabilidades y empieza a frenar la evolución del ecosistema digital.

01 · Ciclos lentos

Cualquier función nueva requiere semanas de análisis, desarrollo y validación por las dependencias internas del LMS.

02 · Dependencia excesiva de plugins

Funciones críticas dependen de extensiones difíciles de mantener, auditar, actualizar o adaptar a nuevas necesidades.

03 · Riesgo en actualizaciones

Cada actualización mayor obliga a revisar compatibilidades, parches, integraciones y personalizaciones acumuladas.

04 · Experiencia de usuario limitada

La interfaz no puede evolucionar al ritmo que esperan estudiantes, docentes o equipos de formación corporativa.

05 · Datos infrautilizados

La información existe dentro del LMS, pero no hay una capa sencilla para explotarla con analítica, automatización o IA.

06 · Integraciones frágiles

Las conexiones con otros sistemas dependen de scripts manuales, procesos opacos o desarrollos difíciles de versionar.

07 · Escalabilidad baja

El LMS termina asumiendo cargas para las que no está optimizado, como vídeo, IA generativa, procesamiento intensivo de datos o experiencias altamente interactivas.

Idea fuerza

La deuda técnica no siempre se ve en el código. A veces se ve en la velocidad a la que una institución deja de poder innovar.

Cuando cada experiencia nueva debe adaptarse a los límites del LMS, la arquitectura deja de ser una base para crecer y empieza a convertirse en una restricción para el producto, los datos y la experiencia educativa.

Por qué añadir más plugins o rehacer el LMS no suele funcionar

+ plugins

Más dependencias que mantener

+ riesgo

En cada actualización mayor

– velocidad

Para lanzar nuevas experiencias

– foco

En producto, datos e innovación

Cuando una organización detecta que su LMS frena la innovación, suelen aparecer dos respuestas instintivas: añadir más plugins o pensar en sustituirlo todo.

Ambas pueden parecer razonables. Sin embargo, si no se gestionan bien, generan más problemas de los que resuelven.

Sobrecargar el LMS con plugins

El primer impulso es buscar un plugin para cada necesidad: gamificación, certificados o IA. No obstante, conviene recordar que el desarrollo de plugins exige arquitectura y mantenimiento real.

Este enfoque puede funcionar al principio. El problema aparece cuando la plataforma acumula dependencias que evolucionan a ritmos distintos.

Por ejemplo, en Moodle, una mala estrategia puede complicar las actualizaciones y degradar el rendimiento. En consecuencia, el resultado suele ser un LMS frágil y difícil de auditar. Como se detalla en la documentación oficial de Moodle sobre herramientas externas, la integración debe planificarse con cuidado.

Intentar sustituir el LMS desde cero

El extremo contrario también es habitual. Cuando el equipo se frustra, aparece la tentación de construir una plataforma propia.

La idea parece atractiva: una interfaz moderna y control total. Pero en la práctica suele ser un error estratégico.

Reconstruir un LMS implica rehacer muchas capacidades que ya están resueltas: gestión de usuarios, roles, matrículas y evaluaciones. Aunque estas piezas no se vean a simple vista, son vitales para la operación.

Además, cambiar de plataforma implica cambiar hábitos de profesores y alumnos. Por lo tanto, no es solo un proyecto de software, sino de cambio organizativo.

Por eso, en la mayoría de casos, la mejor solución no es meterlo todo dentro ni tirarlo todo a la basura. La solución es separar responsabilidades.

La falsa dicotomía

❌ Opción impulsiva 1

Añadir otro plugin para resolver otra necesidad.

❌ Opción impulsiva 2

Rehacer todo el LMS desde cero.

✅ Opción madura (Recomendada)

Separar responsabilidades y construir un ecosistema modular.

Antes y después de una arquitectura Headless LMS

Una forma sencilla de entender el cambio es comparar el antes y el después.

Antes, cualquier nueva necesidad se formula así:

¿Existe un plugin para esto?

Después, la pregunta cambia:

¿Dónde debería vivir esta capacidad dentro del ecosistema?

Ese cambio parece pequeño, pero transforma por completo la toma de decisiones.

📉 Antes: LMS sobrecargado

- Más plugins para cada nueva necesidad.

- Actualizaciones con alto riesgo de fallos.

- Experiencia condicionada por los límites del LMS.

- Datos dispersos y difíciles de usar.

- Innovación dependiente del núcleo académico.

Después: ecosistema modular

- Servicios externos especializados.

- Integración mediante estándares como LTI.

- Experiencias digitales más ágiles.

- Capa de datos lista para analítica e IA.

- Innovación sin tocar la operación académica.

En un modelo centrado solo en el LMS, la arquitectura tiende a crecer hacia dentro. Por lo tanto, cada nueva función se incorpora al mismo núcleo, aumentando el riesgo.

En cambio, en un modelo Headless, la arquitectura crece hacia fuera de forma controlada. El LMS conserva lo académico y las nuevas capacidades se diseñan como piezas externas conectadas por estándares.

Headless LMS: la arquitectura que separa innovación y gestión

Lectura ejecutiva

Un Headless LMS no elimina la complejidad. La ordena. Define qué sistema gobierna cada dato, qué capa innova y cómo evoluciona el ecosistema sin comprometer la estabilidad académica.

Dicho de forma sencilla: el LMS conserva lo que hace bien, la innovación se construye fuera y ambos mundos se conectan de forma controlada.

El término «headless» viene del software y describe arquitecturas donde se separa el sistema de la interfaz. En educación, significa que el LMS deja de ser la única pantalla y pasa a funcionar como un motor académico estable.

Esto no significa ocultar el LMS. Significa darle el papel adecuado. En efecto, pasa de ser una plataforma que intenta resolverlo todo a ser el núcleo de un ecosistema modular.

El LMS debe ser el sistema de confianza, no el laboratorio de experimentación permanente.

Arquitectura · Headless LMS

Principios detrás de un Headless LMS

Un enfoque headless no consiste simplemente en conectar herramientas externas al LMS. Implica diseñar una arquitectura donde cada pieza cumple una función clara, se comunica mediante estándares y puede evolucionar sin comprometer la estabilidad del ecosistema académico.

- Separación de responsabilidades: el LMS conserva la gestión académica esencial, mientras que las plataformas externas se encargan de crear experiencias digitales más ágiles, modernas y especializadas.

- Fuente única de verdad: usuarios, matrículas, cursos, roles y calificaciones oficiales siguen residiendo en el LMS, evitando duplicidades y conflictos entre sistemas.

- Contextos funcionales aislados: cada herramienta externa trabaja dentro de un dominio bien definido, reduciendo dependencias innecesarias y facilitando el mantenimiento.

- Desacoplamiento evolutivo: las nuevas funcionalidades pueden crecer, iterar y desplegarse sin tocar continuamente el núcleo del LMS ni comprometer sus actualizaciones.

- Interoperabilidad basada en estándares: la integración debe apoyarse en LTI 1.3, APIs, eventos y contratos bien definidos, no en parches frágiles o personalizaciones difíciles de mantener.

Qué debe quedarse dentro del LMS

Núcleo institucional

El núcleo que no conviene tocar sin motivo

En una arquitectura Headless LMS, el LMS debe conservar aquello que aporta estabilidad académica, trazabilidad y control institucional. No todo necesita salir fuera: algunas responsabilidades deben permanecer en el núcleo.

01 · Identidad

Perfiles de usuario, autenticación, roles, permisos y políticas de acceso.

02 · Cursos

Estructura académica, aulas virtuales, grupos, cohortes, calendarios y fechas clave.

03 · Evaluación oficial

Libro de calificaciones, actividades evaluables, entregas oficiales y resultados académicos.

04 · Cumplimiento y auditoría

Registros de actividad, evidencias, logs, trazabilidad y requisitos normativos.

05 · Contenido estable

Recursos académicos, materiales base y contenidos que no requieren una experiencia externa diferenciada.

En esta arquitectura, una de las decisiones más importantes es saber qué debe quedarse dentro.

Mi criterio es claro: todo lo que tenga valor institucional o de registro debe permanecer en el LMS.

Esto incluye la identidad, los cursos, las matrículas y las calificaciones. Esta capa debe ser estable y segura. No es el lugar adecuado para experimentar cada semana con una nueva interfaz.

Qué debe construirse fuera del LMS

Capa de innovación

Todo lo que necesite moverse rápido debería vivir fuera

Las experiencias que cambian con frecuencia, que necesitan iterar rápido o que consumen servicios especializados no deberían quedar atrapadas dentro del núcleo del LMS. En una arquitectura headless, estas capacidades viven en plataformas externas conectadas mediante estándares, APIs y eventos.

01 · Experiencias avanzadas

Apps web modernas, interfaces móviles, portales personalizados y experiencias adaptadas a cada perfil de usuario.

02 · IA educativa

Tutores inteligentes, generación asistida de contenidos, recomendaciones, agentes conversacionales y sistemas RAG.

03 · Analítica avanzada

Cuadros de mando, modelos de riesgo, learning analytics, trazabilidad xAPI y explotación de datos académicos.

04 · Herramientas especializadas

Flashcards, simuladores, laboratorios virtuales, microlearning, actividades interactivas y motores de práctica.

05 · Integraciones de negocio

Conexiones con CRM, ERP, pasarelas de pago, sistemas de identidad, herramientas de marketing, soporte o reporting corporativo.

La innovación debe vivir donde pueda evolucionar con rapidez. Y eso, en muchos casos, significa sacarla fuera.

Todo lo que requiera iteración constante, IA o integración con servicios externos suele encajar mejor en una plataforma separada.

La ventaja es evidente: estas piezas pueden escalarse sin tocar el LMS. Si un modelo de IA cambia, se actualiza ese servicio. Si la interfaz necesita una mejora, se evoluciona el externo.

Matriz de decisión: qué va dentro y qué va fuera

Esta arquitectura requiere criterio. Una matriz sencilla puede ayudar a tomar decisiones.

️ Se queda dentro si…

- Forma parte de la evaluación oficial.

- Afecta a matrícula o permisos.

- Requiere registro académico.

- Depende del libro de calificaciones.

- Es estable y poco diferencial.

Se saca fuera si…

- Requiere una experiencia de usuario específica.

- Necesita cambios frecuentes.

- Incorpora IA o procesamiento intenso.

- Debe escalar de forma independiente.

- Tiene lógica de negocio propia.

Regla 1

Si es oficial y trazable, pertenece al LMS.

Regla 2

Si es experimental, debe vivir fuera.

Regla 3

Si necesita ambos mundos, intégralo con estándares.

Headless LMS no significa perder control

Una preocupación razonable al hablar de separar el LMS es el control.

Si cada herramienta externa tiene su propia lógica, ¿no existe el riesgo de fragmentar la experiencia?

Sí, existe. Por esa razón, Headless LMS no debe confundirse con una colección de apps sueltas. De hecho, una arquitectura separada necesita más control, no menos.

Debe existir una estrategia clara sobre identidad, permisos y seguridad. En otras palabras: separar no significa perder el control. Significa cambiar el tipo de control, basándolo en estándares y arquitectura.

Preguntas de control para un ecosistema Headless

- 🔐 Herramientas autorizadas: qué apps pueden conectarse y bajo qué condiciones.

- 📂 Datos compartidos: qué información recibe cada herramienta.

- 📝 Evidencias: qué resultados vuelven al LMS y cuáles quedan fuera.

- ️ Responsabilidad: quién mantiene cada integración.

- ️ Seguridad: cómo se registra el acceso y se revocan permisos.

- ️ Continuidad: qué ocurre si una plataforma externa falla.

El control de un ecosistema no consiste en centralizarlo todo. Consiste en saber qué controla cada sistema y bajo qué reglas.

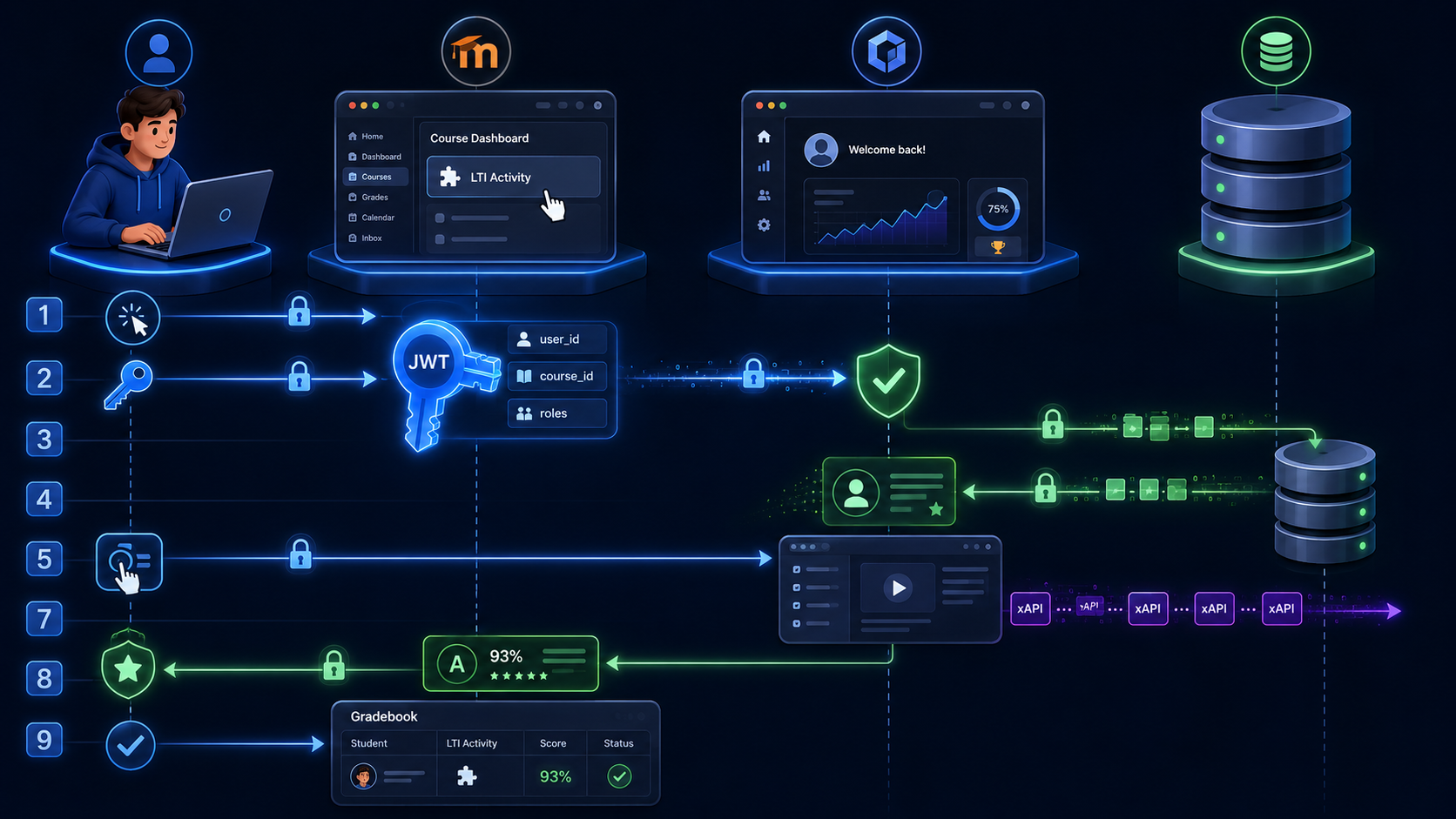

Integración con LTI 1.3: la clave del ecosistema

Separar el LMS de las capas de innovación solo funciona si la integración está bien diseñada. Y aquí es donde los estándares son fundamentales.

El estándar más relevante es LTI 1.3. Este permite conectar herramientas externas con plataformas como Moodle o Canvas de forma segura. En mi guía sobre LTI 1.3 en Moodle explico este flujo con más detalle.

En la práctica, LTI 1.3 permite que un usuario acceda a una herramienta externa sin crear una cuenta nueva y sin perder el contexto.

La herramienta recibe información esencial: quién es el usuario, desde qué curso accede y qué rol tiene. Además, puede devolver calificaciones al libro oficial.

- Elimina fricción: el alumno no percibe que salta a otro sistema.

- Mantiene el contexto: la herramienta trabaja conectada al curso.

- Devuelve resultados: la innovación ocurre fuera, pero la nota queda registrada dentro.

Este punto es clave: LTI no es solo un sistema de login. Es una pieza de arquitectura basada en seguridad moderna (OAuth 2.0 y JWT). Para el seguimiento detallado de interacciones, recomiendo combinar LTI con xAPI (Experience API), que permite capturar eventos de aprendizaje en tiempo real.

LTI 1.3 Advantage

Qué aporta LTI en una arquitectura Headless LMS

LTI permite conectar herramientas externas con el LMS de forma segura, contextual y estandarizada. La aplicación externa puede saber quién es el usuario, desde qué curso accede, qué rol tiene y, cuando corresponde, devolver resultados al libro de calificaciones.

01 · Identidad

El usuario accede desde el LMS sin crear una cuenta nueva en la herramienta externa.

02 · Contexto académico

La herramienta recibe información del curso, la actividad, el rol del usuario y el entorno de lanzamiento.

03 · Resultados

La plataforma externa puede devolver calificaciones, progreso o evidencias al LMS cuando el caso de uso lo requiere.

04 · Seguridad e interoperabilidad

Evita integraciones frágiles basadas en scripts, accesos compartidos o sincronizaciones difíciles de mantener.

Ejemplo: Configuración LTI 1.3 en Moodle

<?php

// Configuración LTI 1.3 - Tool Provider

class LTI13Config {

private string $clientId;

private string $deploymentId;

private string $platformPublicKey;

public function __construct() {

$this->clientId = 'your-client-id';

$this->deploymentId = 'deployment-1';

$this->platformPublicKey = $this->loadPublicKey();

}

public function getLaunchUrl(string $courseId, string $userId): string {

$message = [

'iss' => 'https://moodle.yourinstitution.edu',

'aud' => 'https://tool.external.com',

'sub' => $userId,

'https://purl.imsglobal.org/spec/lti/claim/message_type' => 'LtiResourceLinkRequest',

'https://purl.imsglobal.org/spec/lti/claim/version' => '1.3.0',

'https://purl.imsglobal.org/spec/lti/claim/resource_link' => [

'id' => $courseId,

'title' => 'Curso de Introducción'

],

'https://purl.imsglobal.org/spec/lti/claim/roles' => [

'http://purl.imsglobal.org/vocab/lis/v2/membership#Learner'

],

'exp' => time() + 3600

];

return $this->buildJWT($message);

}

private function buildJWT(array $payload): string {

$header = base64_encode(json_encode([

'typ' => 'JWT',

'alg' => 'RS256'

]));

$body = base64_encode(json_encode($payload));

return $header . '.' . $body;

}

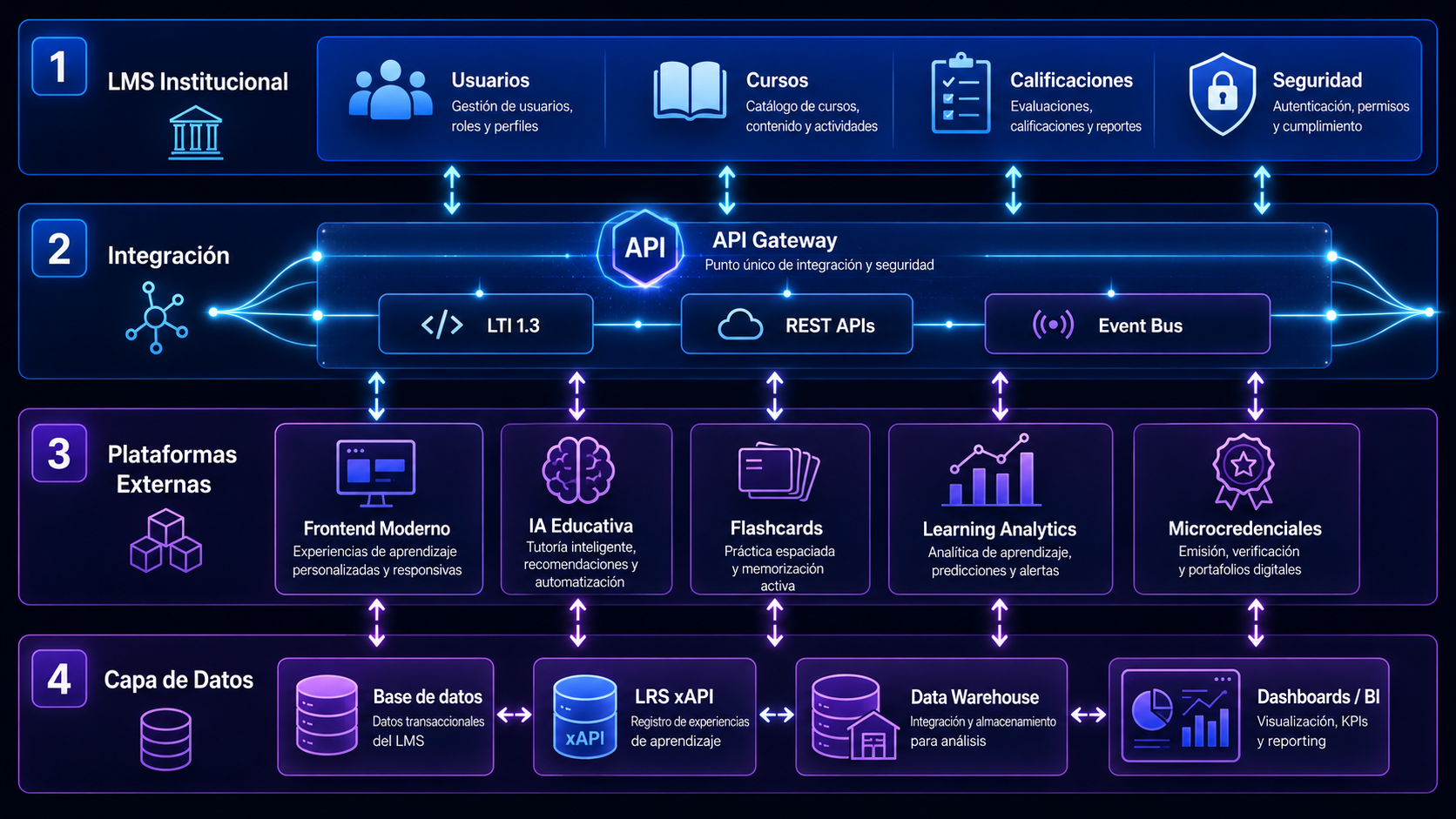

}Arquitectura de referencia para un LMS desacoplado

Esta arquitectura puede variar según la organización, pero normalmente se organiza en capas.

En la base está el LMS. Encima se despliegan plataformas externas. Entre ambos aparece una capa de integración. Y, por último, una capa de datos recoge la actividad.

graph LR

subgraph LMSInstitucional["LMS Institucional"]

A["Moodle / Canvas / Sakai"]

A1["Usuarios y Roles"]

A2["Cursos y Matrículas"]

A3["Libro de Calificaciones"]

A4["Contenido Académico"]

end

subgraph CapaIntegracion["Capa de Integración"]

B["LTI 1.3 Advantage"]

C["APIs REST"]

D["Event Bus"]

end

subgraph PlataformasExternas["Plataformas Externas"]

E["Frontend Moderno"]

F["IA Educativa"]

G["Flashcards / Práctica"]

H["Learning Analytics"]

I["Microcredenciales"]

end

subgraph CapaDatos["Capa de Datos"]

J["LRS xAPI"]

K["Data Warehouse"]

L["Dashboards"]

end

A --> B

A --> C

A --> D

B --> E

B --> F

B --> G

C --> H

C --> I

D --> J

F --> K

H --> K

J --> K

K --> L

graph TB

subgraph LMS["LMS Institucional"]

A[Moodle / Canvas / Sakai]

A1[Usuarios y Roles]

A2[Cursos y Matrículas]

A3[Libro de Calificaciones]

A4[Contenido Académico]

end

subgraph INT["Capa de Integración"]

B[LTI 1.3 Advantage]

C[APIs REST]

D[Event Bus]

end

subgraph EXT["Plataformas Externas"]

E[Frontend Moderno]

F[IA Educativa]

G[Flashcards / Práctica]

H[Learning Analytics]

I[Microcredenciales]

end

subgraph DAT["Capa de Datos"]

J[LRS xAPI]

K[Data Warehouse]

L[Dashboards]

end

A --> B

A --> C

A --> D

B --> E

B --> F

B --> G

C --> H

C --> I

D --> J

J --> K

K --> L

H --> K

F --> K1. LMS institucional

- Usuarios y Cursos

- Evaluación oficial

- Roles y permisos

2. Integración

- LTI 1.3

- APIs

- Eventos

3. Capa Externa

- Frontend moderno

- Motor de IA

- Herramientas

4. Capa de Datos

- Learning Analytics

- Data Warehouse

- Dashboards

graph LR

subgraph Frontend["Frontend"]

A["Web App<br/>React / Vue"]

B["Mobile App"]

end

subgraph ApiGateway["API Gateway"]

C["Kong / Traefik"]

end

subgraph Servicios["Backend Services"]

D["Auth Service"]

E["Course Service"]

F["Analytics Service"]

G["AI Service"]

H["Notification Service"]

end

subgraph DataLayer["Data Layer"]

I[("PostgreSQL")]

J[("MongoDB")]

K[("Redis Cache")]

L[("LRS xAPI")]

end

A --> C

B --> C

C --> D

C --> E

C --> F

C --> G

C --> H

D --> I

E --> I

F --> J

F --> L

G --> K

H --> KEjemplo: API REST para integración

<?php

use App\Http\Controllers\LearningAnalyticsController;

use App\Http\Controllers\StudentProgressController;

use Illuminate\Support\Facades\Route;

// Rutas protegidas con autenticación LTI

Route::middleware(['auth:lti', 'lti.context'])->group(function () {

// Obtener progreso del estudiante

Route::get('/students/{id}/progress', [StudentProgressController::'class, 'index']);

// Analytics en tiempo real

Route::get('/courses/{courseId}/analytics', [LearningAnalyticsController::'class, 'realtime']);

// Predicción de abandono

Route::post('/analytics/predict-dropout', [LearningAnalyticsController::'class, 'predict']);

// Recomendaciones personalizadas

Route::get('/students/{id}/recommendations', [StudentProgressController::'class, 'recommendations']);

});

// Webhook para sincronización con LMS

Route::post('/webhooks/lms/sync', [LMSSyncController::'class, 'handle'])

->middleware('verify.signature');En este modelo, el LMS se convierte en el núcleo fiable. La diferencia es que deja de ser el lugar donde todo debe desarrollarse.

Además, esta arquitectura permite que cada componente evolucione con su propio ritmo. El LMS puede mantener ciclos de actualización prudentes, mientras que las plataformas externas iteran más rápido.

El papel de los eventos

Una pieza que muchas veces se subestima es la capa de eventos.

LTI permite resolver el lanzamiento de herramientas y el retorno de notas. Sin embargo, los eventos permiten observar lo que ocurre en el ecosistema.

💎 Dato clave

Sin eventos, no hay inteligencia educativa real.

Los logs explican parte de la actividad. Pero los eventos bien diseñados explican comportamiento y progreso. Esa es la materia prima de la IA útil.

Cada interacción puede generar una señal: un alumno inicia una sesión, completa una actividad o abandona una tarea.

Si esas señales se capturan bien, la institución puede construir una capa de inteligencia mucho más rica que la que ofrece el LMS por defecto.

Si esas señales se capturan bien, la institución puede construir una capa de inteligencia mucho más rica que la que ofrece el LMS por defecto.

classDiagram

class Student {

+string id

+string email

+string name

+datetime createdAt

}

class Course {

+string id

+string code

+string title

+string lmsContext

}

class Enrollment {

+string id

+string studentId

+string courseId

+string role

+datetime enrolledAt

}

class ActivityEvent {

+string id

+string studentId

+string courseId

+string eventType

+json metadata

+timestamp occurredAt

}

class XapiStatement {

+string id

+string eventId

+json actor

+json verb

+json object

+json result

+timestamp createdAt

}

class Grade {

+string id

+string studentId

+string courseId

+decimal score

+string gradeScale

+datetime gradedAt

}

Student "1" --> "0..*" Enrollment : has

Course "1" --> "0..*" Enrollment : contains

Student "1" --> "0..*" ActivityEvent : generates

Course "1" --> "0..*" ActivityEvent : tracks

ActivityEvent "1" --> "0..*" XapiStatement : converts_to

Student "1" --> "0..*" Grade : receives

Course "1" --> "0..*" Grade : definesEjemplo: Captura de eventos xAPI

// Envío de eventos xAPI desde herramienta externa

class XAPITracker {

constructor(endpoint, auth) {

this.endpoint = endpoint;

this.auth = auth;

this.actor = this.getActor();

}

trackFlashcardStudy(cardId, result, timeSpent) {

const statement = {

actor: this.actor,

verb: {

id: "http://adlnet.gov/expapi/verbs/answered",

display: { "en-US": "studied flashcard" }

},

object: {

id: `https://flashcards.edu/card/${cardId}`,

definition: {

type: "http://adlnet.gov/expapi/activities/cmi.interaction",

interactionType: "choice"

}

},

result: {

success: result === 'correct',

response: result,

duration: `PT${timeSpent}S`,

extensions: {

"https://flashcards.edu/extension/difficulty": "medium"

}

},

context: {

contextActivities: {

parent: [{

id: `https://moodle.edu/course/123`,

definition: {

type: "http://adlnet.gov/expapi/activities/course"

}

}]

}

},

timestamp: new Date().toISOString()

};

return this.sendStatement(statement);

}

async sendStatement(statement) {

const response = await fetch(this.endpoint, {

method: 'POST',

headers: {

'Content-Type': 'application/json',

'Authorization': this.auth,

'X-Experience-API-Version': '1.0.3'

},

body: JSON.stringify(statement)

});

return response.json();

}

getActor() {

return {

objectType: "Agent",

mbox: "mailto:student@university.edu",

name: "María García"

};

}

}

// Uso:

const tracker = new XAPITracker(

'https://lrs.yourinstitution.edu/data/xAPI/',

'Basic dXNlcjpwYXNz'

);

await tracker.trackFlashcardStudy('card-456', 'correct', 15);Headless LMS e IA educativa

La IA ha acelerado todavía más la necesidad de separar responsabilidades. Esta idea está muy alineada con lo que desarrollo en IA en educación sin marketing.

Integrar IA directamente dentro del LMS puede parecer atractivo. Pero en la práctica aparecen preguntas complejas sobre seguridad y permisos.

Por eso, en muchos casos, tiene más sentido construir una capa externa especializada conectada al LMS mediante APIs.

- El LMS aporta contexto: usuario, curso, rol y permisos.

- La capa de IA aporta capacidades: generación de respuestas, clasificación y automatización.

Separar estas capas permite evolucionar la IA sin comprometer el sistema académico.

Ejemplo: Consulta de analytics predictivo

from typing import List, Dict

from datetime import datetime, timedelta

import pandas as pd

from sklearn.ensemble import RandomForestClassifier

class DropoutPredictor:

def __init__(self, db_connection):

self.db = db_connection

self.model = RandomForestClassifier(n_estimators=100)

def calculate_risk_score(self, student_id: str, course_id: str) -> Dict:

# Extraer features del estudiante

features = self._extract_features(student_id, course_id)

# Predecir probabilidad de abandono

dropout_prob = self.model.predict_proba([features])[0][1]

return {

"student_id": student_id,

"course_id": course_id,

"dropout_risk": float(dropout_prob),

"risk_level": self._classify_risk(dropout_prob),

"factors": self._identify_risk_factors(features),

"recommendations": self._generate_recommendations(dropout_prob)

}

def _extract_features(self, student_id: str, course_id: str) -> List[float]:

query = """

SELECT

COUNT(DISTINCT event_id) as total_events,

AVG(time_spent) as avg_time_spent,

COUNT(CASE WHEN event_type = 'assignment_submit' THEN 1 END) as submissions,

COUNT(CASE WHEN occurred_at > NOW() - INTERVAL '7 days' THEN 1 END) as recent_activity,

AVG(grade_score) as avg_grade

FROM activity_events

WHERE student_id = %s AND course_id = %s

"""

result = self.db.execute(query, (student_id, course_id)).fetchone()

return [

result.total_events,

result.avg_time_spent,

result.submissions,

result.recent_activity,

result.avg_grade or 0

]

def _classify_risk(self, probability: float) -> str:

if probability >= 0.7:

return "HIGH"

elif probability >= 0.4:

return "MEDIUM"

else:

return "LOW"

def _generate_recommendations(self, risk: float) -> List[str]:

recommendations = []

if risk >= 0.7:

recommendations.append("Contactar al estudiante inmediatamente")

recommendations.append("Ofrecer tutoría personalizada")

recommendations.append("Revisar dificultades con el contenido")

elif risk >= 0.4:

recommendations.append("Enviar recordatorio de actividades pendientes")

recommendations.append("Sugerir recursos de refuerzo")

return recommendations

# Uso:

predictor = DropoutPredictor(db_connection)

risk_assessment = predictor.calculate_risk_score(

student_id="stu_123",

course_id="course_456"

)

print(f"Riesgo de abandono: {risk_assessment['dropout_risk']:.2%}")

print(f"Nivel: {risk_assessment['risk_level']}")

print("Recomendaciones:")

for rec in risk_assessment["recommendations"]:

print(f" - {rec}")Ejemplo práctico: plataforma de flashcards

Pongamos un ejemplo. Imaginemos una institución que detecta que los alumnos consumen contenidos, pero practican poco.

El LMS permite publicar cuestionarios, pero la experiencia no está pensada para práctica diaria.

En una arquitectura Headless, el enfoque cambia.

La plataforma de flashcards vive fuera. Se integra mediante LTI para recibir el contexto y puede devolver notas al LMS.

En consecuencia, el LMS no se contamina con lógica experimental y la institución obtiene una experiencia más especializada.

Ventajas de un Headless LMS

🚀 Velocidad

Iterar sin depender del núcleo.

🛡️ Estabilidad

Proteger procesos críticos.

📊 Datos

Preparar analítica avanzada.

💼 Negocio

Lanzar nuevas experiencias.

Más velocidad: Cuando la innovación vive fuera, los equipos pueden iterar con más libertad.

Menos riesgo: El LMS sigue siendo estable. Las piezas dinámicas se desarrollan fuera.

Mejor experiencia: Un frontend externo permite diseñar interfaces más cuidadas y rápidas.

Errores comunes al implementar esta arquitectura

️ Advertencia: Separar sin arquitectura solo cambia el problema de sitio.

Un Headless LMS mal diseñado puede convertirse en un conjunto de herramientas aisladas. Por lo tanto, el desacoplamiento necesita criterio, no improvisación.

El error más habitual es pensar que consiste simplemente en desarrollar una app externa. No es eso. Implica diseñar límites claros y definir qué sistema es la fuente de verdad.

Estrategia progresiva

Una de las ventajas es que no exige una migración completa desde el primer día.

De hecho, mi recomendación es empezar por un caso de uso concreto. Puede ser una herramienta de práctica activa o un dashboard de analítica.

- Identifica un problema: una necesidad clara donde el LMS esté limitando.

- Diseña una herramienta pequeña: evita empezar con una plataforma enorme.

- Integra con LTI 1.3: conserva identidad y contexto.

- Mide impacto: uso, retención y satisfacción.

- Escala el patrón: replica la arquitectura en nuevos casos.

El LMS no desaparece: evoluciona

La discusión no debería ser si conservar o sustituir el LMS. La pregunta correcta es otra:

¿Qué papel debe ocupar el LMS dentro de nuestra arquitectura?

En muchas organizaciones, el LMS debe seguir siendo el núcleo institucional: sólido y seguro. Pero no tiene por qué ser el único lugar donde ocurre la innovación.

Al adoptar esta filosofía, la organización gana una arquitectura más modular y mejor preparada para el futuro.

Deja una respuesta